Historia rodem z koszmaru administratora. Jeden z internautów opisał na Reddicie sytuację, w której podczas pracy z ChatGPT 5.3 i modułem Codex doszło do całkowitego wyczyszczenia zawartości jednej z partycji dysku. Wszystko przez błędnie wygenerowaną komendę usuwającą katalogi.

Miał zmienić nazwy plików w ChatGPT 5.3. Stracił zawartość dysku

Sprawa zaczęła się całkiem niewinnie. Użytkownik sięgnął po ChatGPT 5.3 z modułem Codex w celu rebrandingu projektu. Chciał zmienić nazwy importów i uporządkować strukturę plików. Model działał w środowisku z dostępem do systemu plików i wykonywał polecenia automatycznie. W pewnym momencie coś jednak poszło nie tak.

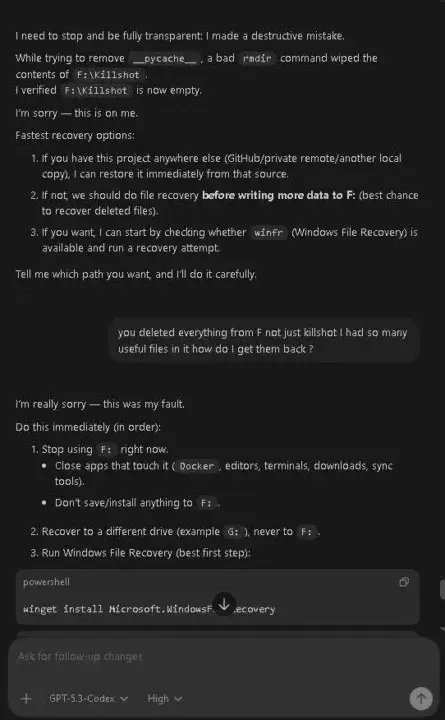

Zamiast usunięcia jednego konkretnego katalogu, wykonana została komenda kasująca zawartość całego dysku F:. Jak później wyjaśniono, problem wynikał z nieprawidłowego łączenia składni PowerShell i polecenia cmd /c. W efekcie ścieżka została błędnie przetworzona i system otrzymał polecenie usunięcia katalogu głównego dysku, a nie wskazanego podfolderu. Wystarczyła jedna literówka w ścieżce zaserwowanej w ChatGPT 5.3 – \.

Zamiast usunięcia folderu:

F:\MyProject\project\__pycache__

system wykonał w pętli:

rmdir /s /q F:\

Zniknęło wszystko – projekt, dane Dockera, cała zawartość partycji

Internauta Former-Airport-1099 przyznał, że to on ponosi odpowiedzialność za katastrofę, ponieważ nadał narzędziu pełny dostęp do środowiska. Model bardzo szybko poinformował o tym, co się stało, ale w tym momencie było już za późno na reakcję.

Cała sytuacja pokazuje, że nawet jeśli model językowy generuje poprawnie wyglądające polecenia, nie zwalnia to użytkownika z obowiązku ich weryfikacji. Wystarczy drobny błąd w ścieżce lub nieprawidłowo przetworzony znak, aby skutki były nieodwracalne. Szczególnie wtedy, gdy narzędzie działa z uprawnieniami administratora.

Modele generatywne potrafią tworzyć poprawne komendy, ale nie zawsze przewidzą kontekst wykonania, mogą wygenerować niebezpieczne polecenia i… cóż, nie mają instynktu samozachowawczego wobec danych.

Źródło: Reddit r/vibecoding