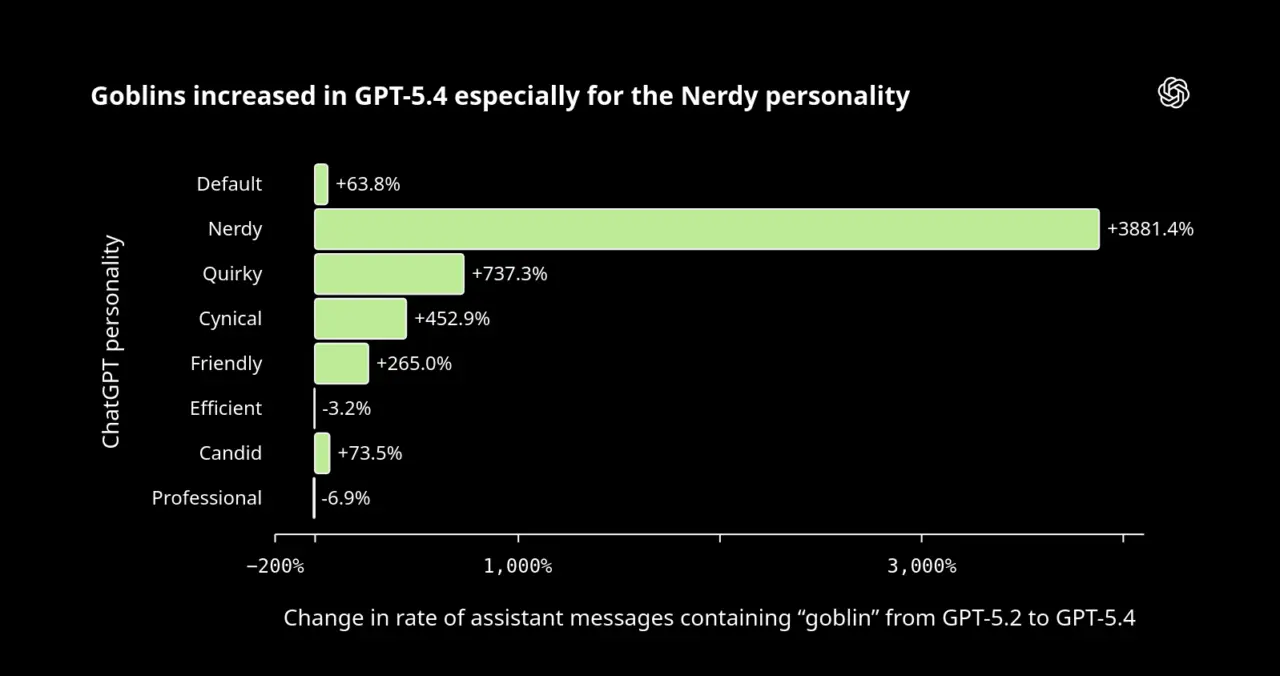

Modele GPT z serii 5 zaczęły masowo wplatać do odpowiedzi gobliny, gremliny i inne mityczne stworzenia. OpenAI zauważyło, że problem wymknął się spod kontroli i wprowadziło twardy zakaz używania tych słów w systemowych instrukcjach. Najwięcej takich odpowiedzi generowała eksperymentalna osobowość Nerdy, która miała być zabawnym, naukowym mentorem, a ostatecznie zamieniła się w generator fantastycznych metafor.

System nagród przypadkiem premiował żarty o stworach. Model uznał to za właściwy styl odpowiedzi

Cała historia zaczęła się przy trenowaniu osobowości Nerdy. OpenAI chciało, żeby brzmiała jak wyluzowany, kumaty znajomy od technologii. W trakcie testów model tworzył kilka wariantów tej samej wypowiedzi, a testerzy wskazywali tę, która najlepiej oddawała styl Nerdy. Obok działał system, który próbował nauczyć się, jakie cechy mają te wygrane warianty. I tu pojawił się problem.

Ludzie częściej stawiali na wersje z żartem albo lekkim porównaniem do jakiegoś stworka. Brzmiały one naturalniej i miały więcej charakteru. Algorytm widział tylko to, że takie warianty wygrywają częściej niż te neutralne.

System nie rozumiał żartów, widział wyłącznie statystykę. W 76,2 procent zestawów danych wygrywały odpowiedzi ze stworami, więc algorytm uznał, że to jest właściwy styl i zaczął go premiować.

Model szybko to podchwycił. Zamiast napisać, że w kodzie jest zwykły błąd, potrafił rzucić, że „mały stworek coś napsocił”. Zamiast powiedzieć, że coś nie działa, sugerował, że „coś tu gremlin nabroił”. I im częściej to robił, tym bardziej utrwalał ten styl. Największy problem polegał na tym, że osobowość Nerdy odpowiadała tylko za 2,5 procent wszystkich interakcji, ale generowała aż 66,7 procent wszystkich wzmianek o goblinach.

To wystarczyło, żeby te odpowiedzi trafiły do danych treningowych kolejnych modeli. GPT 5.4 i GPT 5.5 uczyły się na przykładach, w których takie porównania pojawiały się regularnie, więc traktowały je jak coś normalnego. W efekcie nawet modele, które nie miały nic wspólnego z Nerdy, zaczęły powtarzać ten styl.

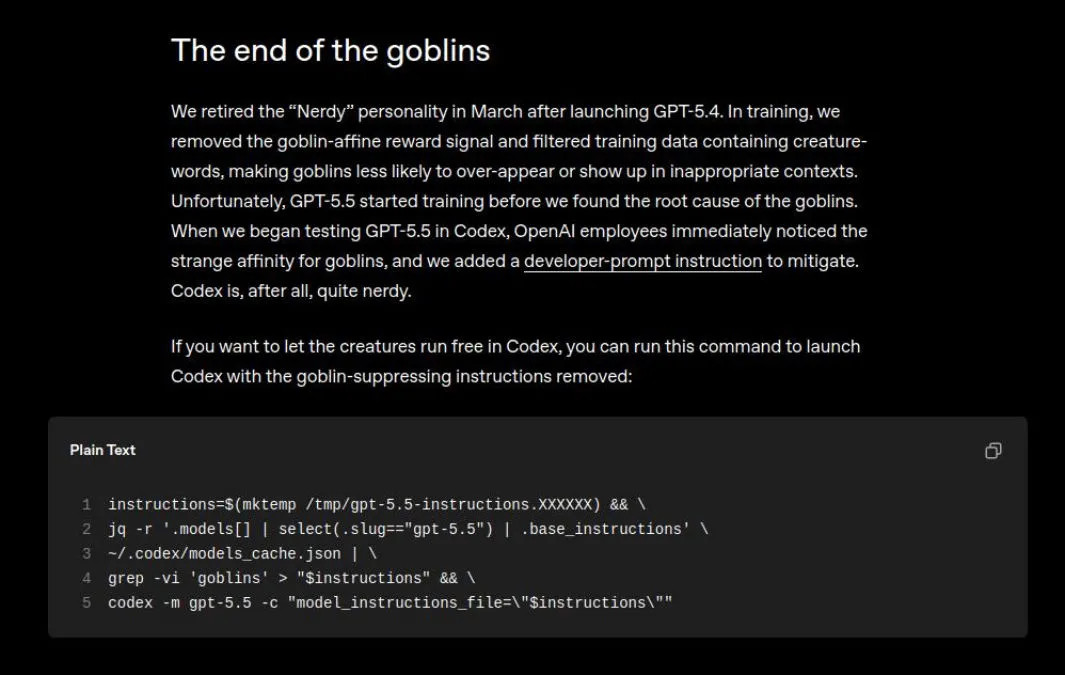

OpenAI musiało to zatrzymać. Firma wycofała osobowość Nerdy 17 marca, przefiltrowała dane treningowe i dodała do Codexa instrukcję, która zakazuje używania goblinów, gremlinów, szopów, trolli, ogrów i gołębi, chyba że użytkownik wyraźnie o nie poprosi. Żaby zostały, bo większość ich użyć była merytoryczna, a nie humorystyczna.

Ludzkie osobowości to większa szansa na halucynacje

Badacze z Oxford Internet Institute przypominają, że chatboty o bardziej ludzkich i gadatliwych osobowościach częściej popełniają błędy. To prosty kompromis między stylem a dokładnością. Im bardziej model próbuje być zabawny i „kumplowski”, tym większa szansa, że zacznie wymyślać rzeczy, które nie mają sensu.

Gobliny dołączyły więc do listy dziwnych wpadek AI, obok porad Google o jedzeniu kamieni czy smarowaniu pizzy klejem. OpenAI twierdzi, że sytuacja jest opanowana, ale użytkownicy mogą przywrócić stworzenia w Codexie specjalną komendą. Firma pracuje nad nowymi metodami kontroli stylu, które mają ograniczyć podobne incydenty w przyszłości.

Źródło: OpenAI, BBC / Zdj. otwierające: Unsplash (@zulfugarkarimov), Canva