Google ogłosił pierwszy w historii przypadek wykrycia exploita typu zero-day, który według badaczy mógł powstać przy użyciu sztucznej inteligencji. Zespół Google Threat Intelligence Group wskazuje, że cyberprzestępcy planowali wykorzystać lukę w szeroko zakrojonym ataku, jednak jej wcześniejsze wykrycie mogło zapobiec zagrożeniu. To pierwszy tak wyraźny sygnał. Pokazuje on, że AI zaczyna odgrywać rolę nie tylko w obronie, ale także w tworzeniu narzędzi do cyberataków.

Pierwszy przypadek udziału AI w tworzeniu exploita zero-day

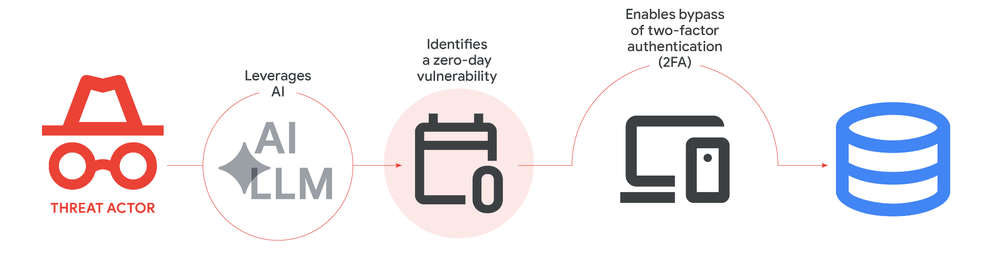

Według informacji przekazanych przez Google oraz zespół Google Threat Intelligence Group, po raz pierwszy udało się zaobserwować sytuację, w której luka typu zero-day mogła zostać odkryta i przygotowana do wykorzystania przy wsparciu sztucznej inteligencji. Tego typu podatności są szczególnie niebezpieczne. Pozostają one nieznane producentom oprogramowania i użytkownikom aż do momentu ich ujawnienia lub wykorzystania w ataku.

W tym przypadku badacze wskazują, że cyberprzestępcy planowali użycie exploita w dużej, zorganizowanej kampanii. To wskazuje na potencjalnie szeroki zasięg zagrożenia. Google zaznacza jednak, że dzięki wczesnemu wykryciu udało się najprawdopodobniej zapobiec jego realnemu użyciu. Firma podkreśliła również, że nie ma dowodów na wykorzystanie w tym przypadku modeli Google Gemini. Istnieje jednak wysokie prawdopodobieństwo, że jakiś model AI brał udział w procesie identyfikacji i uzbrajania podatności. Oznacza to, że sztuczna inteligencja mogła zostać wykorzystana nie tylko jako narzędzie analityczne, ale także jako element wspierający tworzenie realnych narzędzi ataku. Google nie ujawniło szczegółów dotyczących samej luki ani celu, jednak poinformowało zaatakowaną organizację, która szybko wdrożyła poprawkę bezpieczeństwa.

AI coraz częściej narzędziem zarówno ataku, jak i obrony

Raport Google Threat Intelligence Group zwraca uwagę na fakt, że już w przeszłości grupy powiązane z Chinami i Koreą Północną wykazywały szczególne zainteresowanie wykorzystaniem sztucznej inteligencji w cyberoperacjach. Analitycy uważają, że to dopiero początek zjawiska, w którym cyberprzestępcy mogą wykorzystywać AI na wielu etapach ataku. Obejmuje to analizę podatności, tworzenie exploitów, a także ich wdrażanie w rzeczywistych kampaniach.

W rozmowie przytoczonej przez media jeden z ekspertów GTIG określił sytuację jako „pierwszy namacalny dowód” nowego trendu. Jednocześnie uznał ją za zapowiedź tego, co może stać się znacznie częstsze w przyszłości. Google podkreśla jednak, że te same technologie mogą działać w odwrotnym kierunku i wspierać obronę systemów. Sztuczna inteligencja jest już wykorzystywana do wykrywania zagrożeń i analizy podatności zanim zostaną one użyte przez atakujących. Takie podejście rozwijają różne firmy z branży cyberbezpieczeństwa np. Anthropic, które testują systemy oparte na modelach AI do identyfikowania krytycznych luk i ich neutralizowania.

Źródło: Google, Engadget / Zdjęcie otwierające: Wygenerowano przy użyciu AI