Firma Microsoft już pewien czas temu postawiła sobie za cel stworzenie środowiska przyjaznego wszystkim graczom. Nie mówię tu już o specjalnych kontrolerach zaprojektowanych dla osób z niepełnosprawnością czy z problemami wzroku, a samym nastawieniu koncernu do pojęcia toksyczności. Wszystko wskazuje na to, że już niedługo użytkownicy Xbox Live odczują dosyć sporą zmianę w korzystaniu ze swoich kont.

Jak się okazuje, Microsoft rozpoczął kilka dni temu testy filtracji wiadomości tekstowych przesyłanych za pośrednictwem Xbox Live. Za moderację odpowiadać ma oczywiście sztuczna inteligencja, lecz jeśli myślicie, że pomysł giganta opiera się na zablokowaniu możliwości wypisywania konkretnych fraz, to nic bardziej mylnego. Koncern podszedł do tematu nieco bardziej poważnie.

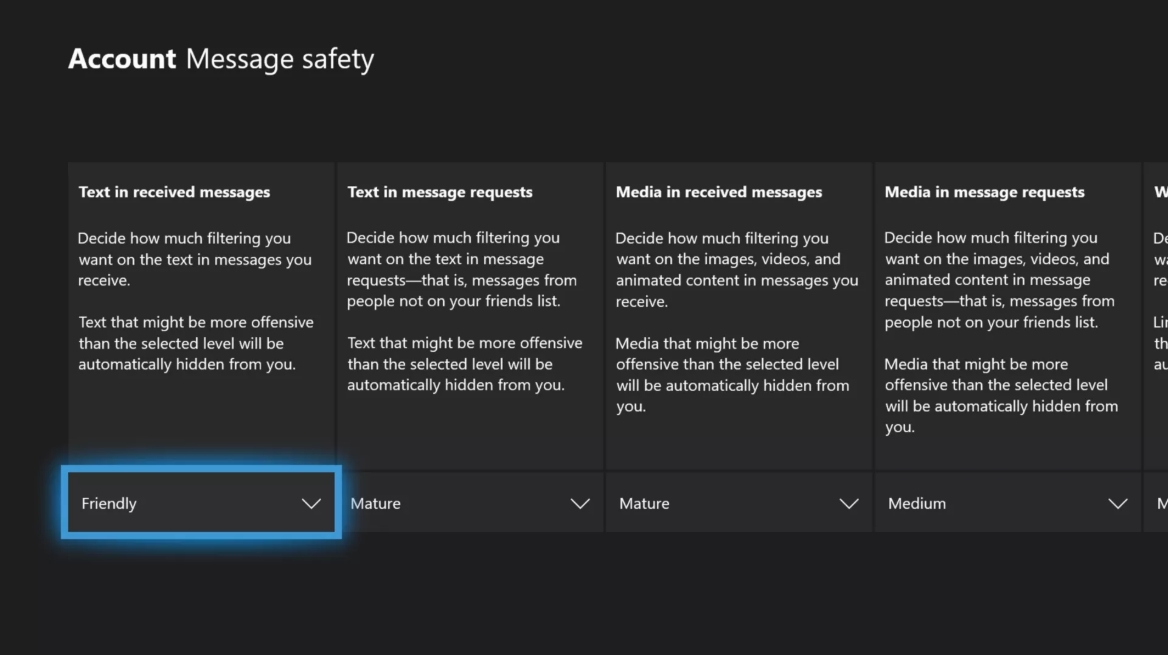

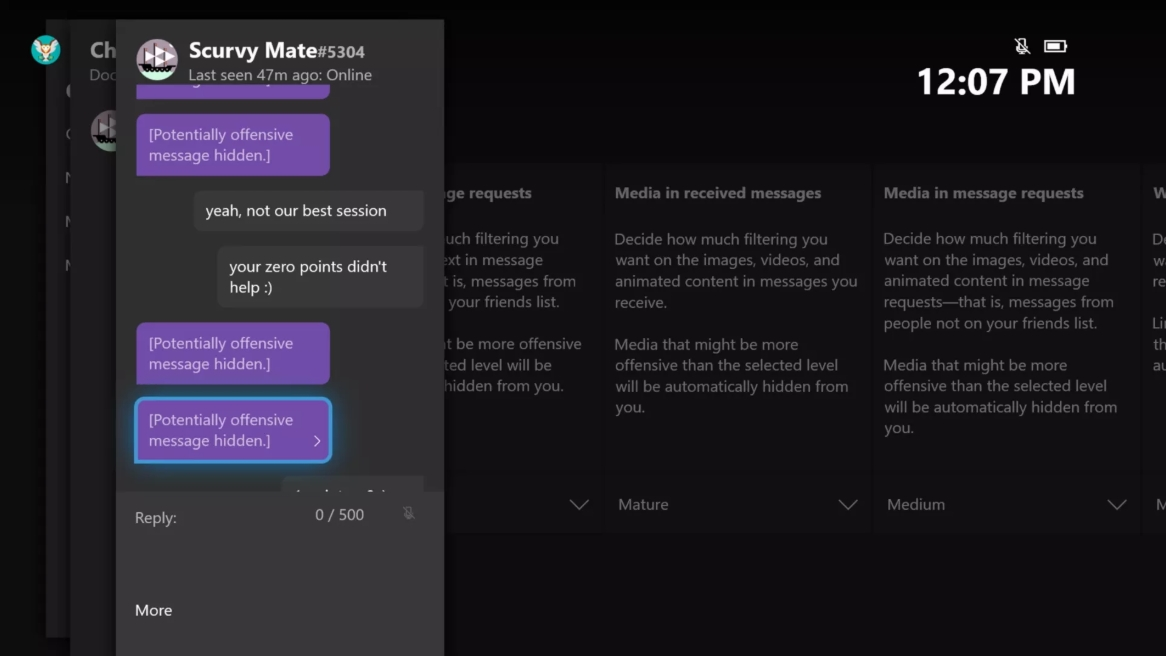

Dostępne mają być cztery poziomy filtrowania tekstowego – przyjazny, średni, dojrzały i taki, gdzie filtracja nie będzie obowiązywać. W przypadku pierwszego poziomu, wszystkie treści „potencjalnie obraźliwe” zostaną zakryte przez odpowiedni komunikat. Następne stopnie filtracji będą analogicznie „pobłażliwiej” traktować tzw. mowę nienawiści.

Wszystko to znajduje się dopiero we wczesnej fazie rozwoju, lecz Microsoft snuje już rozległe plany na przyszłość. Stosunkowo niedługo, filtracja objąć ma także wiadomości głosowe wysyłane m.in. podczas rozgrywki w przeróżnych produkcjach. Pamiętajmy oczywiście, że mówimy o „cenzurze” dobrowolnej – wystarczy wyłączyć filtrację, a obraźliwe treści znów będą widoczne.

Wolność słowa ma jednak swoją granicę tam, gdzie te słowa zaczynają krzywdzić innych i Microsoft doskonale zdaje sobie z tego sprawę. System zgłaszania toksycznych graczy ma zostać ulepszony, a sama moderacja usprawniona. Gigant najwidoczniej ma poważne plany związane z „uzdrowieniem” gamingowego środowiska.

Filtracja obejmie system wiadomości tekstowych na konsoli Xbox One, aplikacji Xbox Game Bar oraz programach Xbox na platformach Windows 10, iOS oraz Android.

Źródło: The Verge