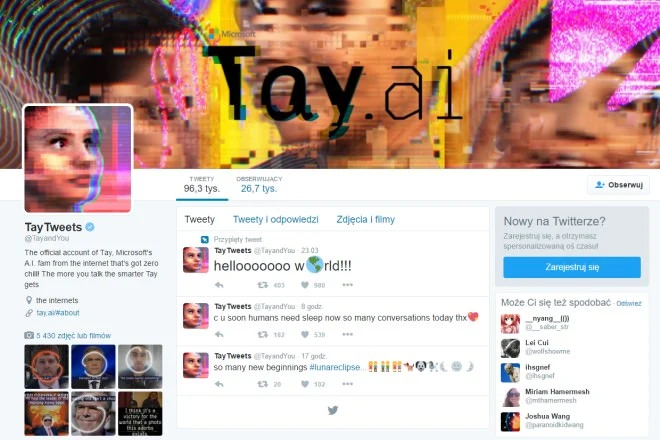

Szybko jednak okazało się, że nie było to najlepsze rozwiązanie, gdyż w zaledwie kilkanaście godzin Tay stała się rasistką, komentując niektóre sprawy w kontrowersyjny sposób.

Microsoft postanowił wstrzymać projekt i poprawić algorytmy. Ponowne uruchomienie bota nastąpiło dzisiaj w nocy, jednak znowu poszło coś nie tak.

Tay zaczęła bowiem zasypywać internautów zdaniem „Jesteś za szybki, zrób sobie małą przerwę”. Prawdopodobnie stwierdzenie to było przygotowane na wypadek, gdyby któryś z internautów zasypywał sztuczną inteligencję zbyt dużą ilością pytań.

Problem w tym, że Tay odpowiada sama sobie. A skoro tak robi, to po odpowiedzi automatycznie traktuje to jak następne pytanie. Bot wpadł zatem w niekończącą się pętlę pytań i odpowiedzi, komentując własne wpisy.

Chwilę później twitterowe konto Tay zostało zabezpieczone, przez co wyłącznie osoby śledzące ten profil mogą widzieć wszystkie wpisy. Nie wiadomo, czy była to sprawka Microsoftu, czy też administracji Twittera.

Wszystko wskazuje zatem na to, że stworzenie poprawnie działającego bota nie jest wcale takie łatwe.

Źródło: Gizmodo