Obrazy tworzone przez sztuczną inteligencję zalewają dziś media społecznościowe, portale informacyjne i komunikatory. Modele graficzne osiągnęły poziom, który potrafi zmylić nawet doświadczonych użytkowników. Coraz trudniej jest odróżnić prawdziwe zdjęcie od generowanego – jednak nadal jest to możliwe.

Przedstawiamy konkretne sposoby, by zwiększyć swoje szanse na wykrycie manipulacji. Nie dają one stuprocentowej pewności, ale połączone razem pozwalają bardzo skutecznie demaskować cyfrowe fałszerstwa. Oto siedem metod, które dziś wciąż działają.

Znaki wodne

Pierwszym sygnałem ostrzegawczym jest znak wodny, który czasem pojawia się w rogach obrazu. Użytkownicy często go ignorują lub nie wiedzą, że dany symbol pochodzi z narzędzia AI. Warto wyszukać nieznane oznaczenia i sprawdzić ich pochodzenie.

Co ważne, część znaków jest niewidoczna. Przykładem jest technologia SynthID stosowana przez Google w obrazach Gemini. Można spróbować przeskanować grafikę przy pomocy samego Gemini. Brak znacznika nie oznacza jednak, że obraz na pewno nie jest sztuczny – obraz mógł zostać przycięty.

Źródło i kontekst

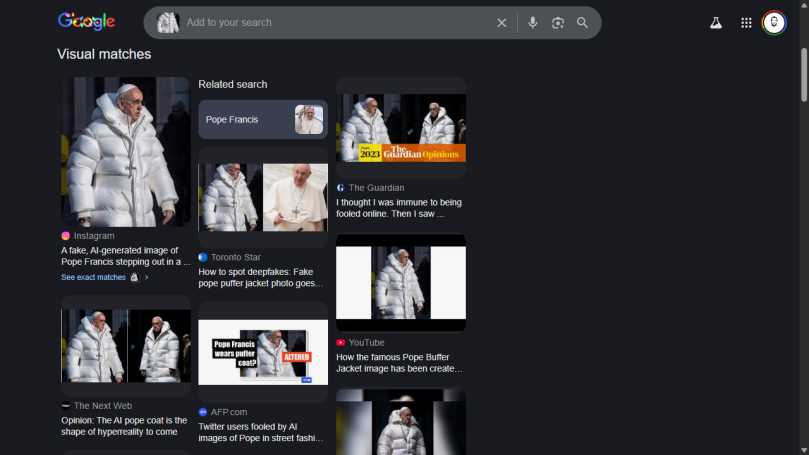

Drugą metodą jest sprawdzenie źródła obrazu. Jeśli grafika rzekomo pochodzi z filmu, wydarzenia lub transmisji, wyszukiwanie obrazem powinno szybko potwierdzić jej autentyczność. Brak jakichkolwiek śladów w wiarygodnych mediach to bardzo silna przesłanka, że mamy do czynienia z grafiką AI.

Równie ważny jest kontekst samej sceny. Obrazy AI często przedstawiają wnętrza z nielogicznym układem, sprzęty zupełnie nie na swoim miejscu albo sytuacje, które nie mają sensu. Jeżeli zdjęcie przedstawia znaną osobę w absurdalnej lub sprzecznej z jej wizerunkiem sytuacji, warto zachować szczególną ostrożność.

Zdeformowany tekst

Trzecią metodą jest analiza napisów widocznych na obrazie. Sztuczna inteligencja wciąż miewa trudności z poprawnym generowaniem dłuższych tekstów. Litery bywają rozmazane, zdeformowane lub tworzą kompletnie bezsensowne słowa.

Co prawda nowoczesne modele, takie jak Nano Banana Pro, potrafią już generować poprawne pojedyncze napisy, jednak nadal zawodzą przy dużej ilości tekstu – na przykład na stronach książek czy dokumentach widocznych na fotografii. Każdy fragment napisu warto dokładnie obejrzeć.

Zbyt idealne elementy lub niepasujące detale

Czwarty sygnał to wrażenie, że coś „nie gra” wizualnie. Obrazy AI często są zbyt gładkie, zbyt czyste albo mają nienaturalnie rozmyte tło. Postacie potrafią wyglądać przesadnie idealnie albo przeciwnie – niespójnie i przypadkowo. Nawet nowoczesne generatory pozostawiają takie ślady. Dotyczą one proporcji, faktur skóry, oświetlenia, a czasem drobnych detali w tle, które nie pasują do reszty sceny.

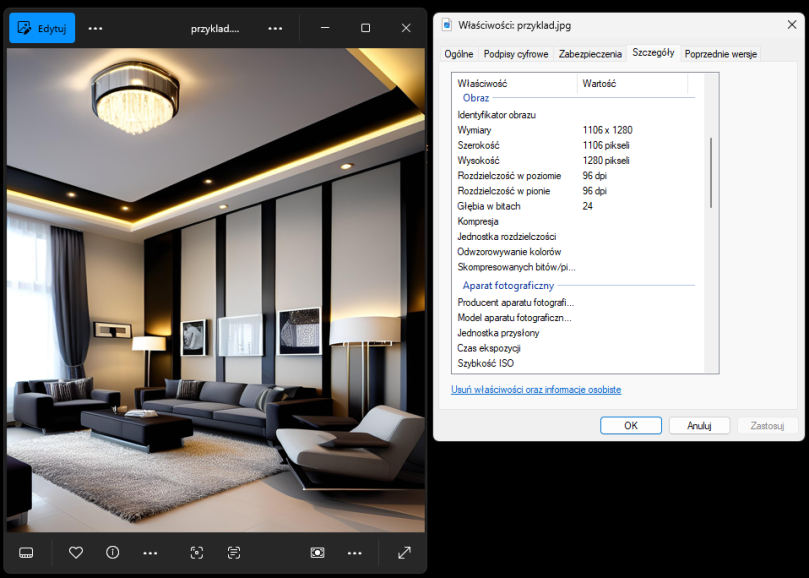

Przykłady znajdą się na wszystkich wcześniejszych ilustracjach. W przypadku obrazka z Papieżem Franciszkiem w kurtce Balenciagi to niedokładnie wygenerowane dłonie i zagięcia materiału. Na grafice przedstawiającej salon, generator „ustawił” łącznie 3 stoły i 2 stoliki kawowe. Na sielankowym grillu prezydenckim jedna ze szklanek ma etykietę, a trzem butelkom jej brakuje. Z kolei pokój przedstawiony poniżej jest zbyt „gładki” i rozmyty.

Jakość pliku ma znaczenie

Piątą metodą jest sprawdzenie parametrów technicznych obrazu. Grafiki generowane przez AI są najczęściej silnie skompresowane i zapisane w formatach takich jak JPEG o niskiej rozdzielczości, często 720p.

Pliki RAW praktycznie wykluczają pochodzenie z AI. Choć nowe modele potrafią już tworzyć obrazy w 4K, zasada pozostaje aktualna: im wyższa jakość techniczna i mniejsza kompresja, tym mniejsze prawdopodobieństwo, że to dzieło algorytmu.

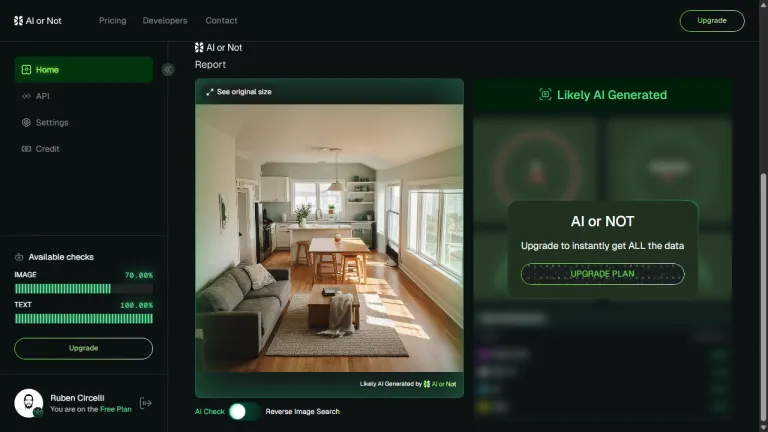

Wykrywacz AI

Szóstą metodą są automatyczne detektory obrazów AI dostępne w sieci. Narzędzia te analizują piksele i metadane, a następnie podają procentowe prawdopodobieństwo, że dana grafika powstała przy użyciu sztucznej inteligencji.

Nie są one nieomylne, dlatego nigdy nie należy polegać wyłącznie na jednym wyniku. Mogą jednak stanowić dodatkowe potwierdzenie wcześniejszych podejrzeń. Z wspomnianego wcześniej Gemini, ChatGPT czy Groka skorzystamy za darmo, przynajmniej do analizy kilku obrazów dziennie. Dedykowane wykrywacze jak AI or Not udostępnią nam częściowy wynik, a za dokładny każą zapłacić.

Kilka sygnałów to już dowód

Siódma i najważniejsza zasada brzmi: jeden sygnał to za mało, ale kilka naraz to już dowód. Jeśli obraz ma zdeformowany tekst, brak mu źródła, kontekst jest nielogiczny i jeszcze nie przechodzi testu detektora – możemy już być pewni, że to nie dzieło człowieka.

W dobie dezinformacji najlepiej przyjąć zasadę ograniczonego zaufania. Dopóki dana grafika nie pojawi się w kilku wiarygodnych źródłach, warto zakładać, że może być wytworem algorytmu, a nie prawdziwą fotografią.

Źródło: PCMag

Zdjęcie otwierające: The Guardian