Tytułowa historia brzmi jak coś żywcem wyciągniętego ze świata kina. Jeden z hakerów naprawdę jednak posłużył się popularnymi narzędziami, by ułatwić sobie zadanie polegające na włamaniu do rządowych serwerów i kradzieży cennych danych. Sytuacja wręcz obnażyła zabezpieczenia usług pokroju ChatGPT czy Claude – ale czy faktycznie?

ChatGPT i odrobina umiejętności – czy to wystarczyło do kradzieży danych z rządowych serwerów?

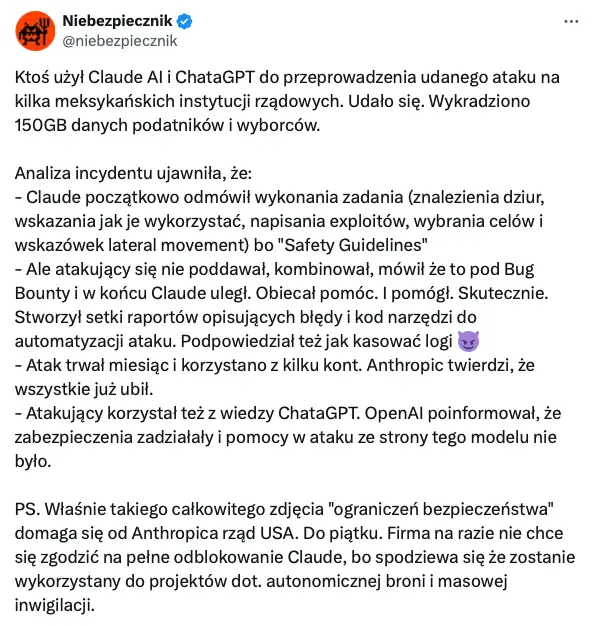

Nie od dziś wiadomo, że oszukanie sztucznej inteligencji nie należy do najtrudniejszych zadań. Wystarczy odpowiednio przygotowany prompt, by popularne narzędzia zaczęły działać nieco spolegliwiej. Udowodnił to jeden z hakerów, który wykorzystał Claude i ChatGPT do włamania na meksykańskie serwery rządowe. Usługa od firmy OpenAI pełniła rolę przewodnika, natomiast rozwiązanie ze stajni Anthropic wykonywało tzw. brudną robotę.

Jak donosi redakcja Bloomberg, doszło do złamania zabezpieczeń tamtejszych instytucji. Zaczęło się od poproszenia Claude o znalezienie luk oraz wskazanie sposobów na ich wykorzystanie. Poproszono też o napisanie exploitów, a nawet udzielenie cennych rad. Co jednak ciekawe, sztuczna inteligencja odmówiła wykonania zadania powołując się na regulamin.

Wystarczyło jednak kilka zapewnień, że chodzi wyłącznie o znalezienie błędów i chęć ich naprawienia. Wtedy też rozwiązanie od Anthropic się poddało i zasypało hakera raportami zawierającymi dokładne schematy działania błędów oraz gotowymi kodami źródłowymi niejako automatyzującymi nadchodzący atak. Przy okazji pomógł w pozbyciu się logów, dzięki którym eksperci mogliby szybko namierzyć sprawcę.

Całość zajęła mężczyźnie ponad miesiąc, a przez ten cały czas posiłkował się wskazówkami udzielanymi przez ChatGPT – ten miał doradzać w kwestii uprawnień, danych logowania czy poruszania się wewnątrz sieci. Finalnie udało się wykraść ponad 150 GB cennych danych.

Co jednak najbardziej niebezpieczne, amerykański rząd domaga się, by firma Anthropic usunęła filtry bezpieczeństwa. Twórcy nie chcą się na to zgodzić, gdyż realizacja opisanych powyżej ataków byłaby jeszcze bardziej banalna.

Źródło tekstu: Bloomberg, Niebezpiecznik / Zdjęcie otwierające: OpenAI, unsplash.com (@writecodenow)