Chociaż sztuczna inteligencja potrafi świetnie wykonywać wiele zadań, okazuje się, że generowanie bezpiecznych haseł wcale do nich nie należy. Najnowsze badania pokazują, że hasła tworzone przez duże modele językowe np. ChatGPT, Claude czy Gemini, często wydają się skomplikowane, ale w praktyce są przewidywalne i łatwe do złamania. Eksperci ostrzegają, że poleganie na AI w tym zakresie może stworzyć złudne poczucie bezpieczeństwa, a w rzeczywistości znacząco zwiększyć ryzyko przejęcia kont online.

Powtarzalność haseł wygenerowanych przez AI zaskakuje ekspertów

Badacze z firmy Irregular przeanalizowali setki haseł wygenerowanych przez duże modele językowe i szybko zauważyli powtarzalne schematy. W jednym z testów 50 haseł wygenerowanych przez Claude Opus 4.6 zawierało zaledwie 30 unikalnych ciągów. Pozostałe były duplikatami, z czego większość identycznymi. Podobne wzory pojawiały się w wynikach ChatGPT i Gemini. W tym przypadku pierwsze znaki były niemal zawsze takie same. Dodatkowo wiele liter alfabetu w ogóle nie było wykorzystywanych. Takie przewidywalne schematy sprawiają, że nawet hasła wydające się losowe stają się łatwe do złamania przez cyberprzestępców.

Co ciekawe, wiele takich haseł bez problemu przechodzi popularne internetowe testy siły zabezpieczeń. Narzędzia te oceniają bowiem długość i różnorodność znaków, ale nie wykrywają ukrytych wzorców statystycznych. W efekcie użytkownik widzi komunikat o „bardzo silnym haśle”, ale w rzeczywistości liczba możliwych kombinacji jest znacznie mniejsza, niż sugeruje pasek bezpieczeństwa.

Dlaczego sztuczna inteligencja nie radzi sobie z tym zadaniem?

Eksperci wyjaśniają, że problem wynika z działania dużych modeli językowych. Systemy te uczą się generować wyniki na podstawie statystycznych wzorców, a nie prawdziwej losowości. W praktyce oznacza to, że hasła wyglądają na skomplikowane, ale mają niską entropię i są przewidywalne.

Analizy wykazały, że różnica w poziomie entropii między hasłem generowanym kryptograficznie a tym tworzonym przez model językowy może być kilkukrotna. Oznacza to znacznie mniejszą liczbę możliwych kombinacji, niż sugeruje sama długość ciągu. Nawet brak powtarzających się znaków nie poprawia ich bezpieczeństwa. Losowość musi wynikać z prawdziwie chaotycznego ułożenia znaków. Wnioski są jasne – niezależnie od tego, jak „inteligentne” wydaje się AI, nie można polegać na niej w kwestii tworzenia bezpiecznych haseł.

Używałeś AI do stworzenia hasła? Lepiej je zmień

Wniosek ekspertów jest jednoznaczny. Duże modele językowe nie są zaprojektowane do generowania prawdziwie losowych ciągów znaków. Ich celem jest tworzenie odpowiedzi, które są statystycznie prawdopodobne i „brzmią sensownie”, a to dokładne przeciwieństwo tego, czego wymaga bezpieczeństwo. Jeśli więc wygenerowałeś hasło przy pomocy AI i używasz go do logowania w ważnym serwisie, warto rozważyć jego natychmiastową zmianę.

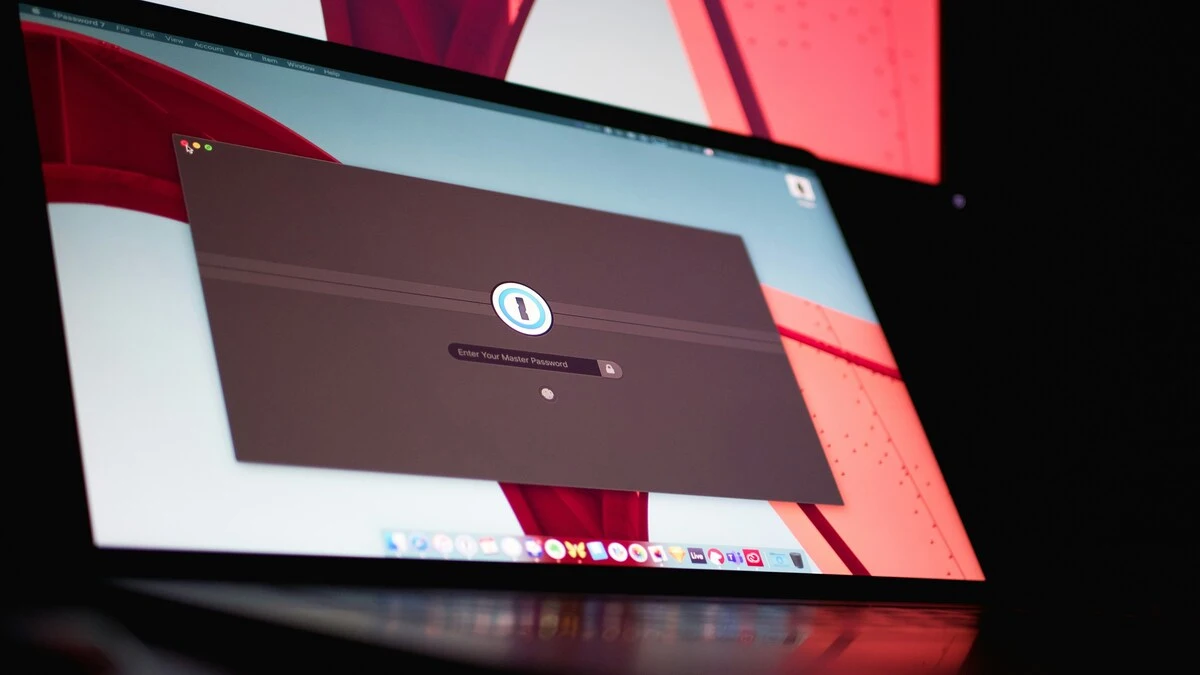

Najbezpieczniejszym rozwiązaniem pozostają sprawdzone menedżery haseł korzystające z kryptograficznych generatorów liczb losowych, które nie opierają się na przewidywalnych wzorcach.

Źródło: Gizmodo / Zdjęcie otwierające: unsplash (@vodriian)