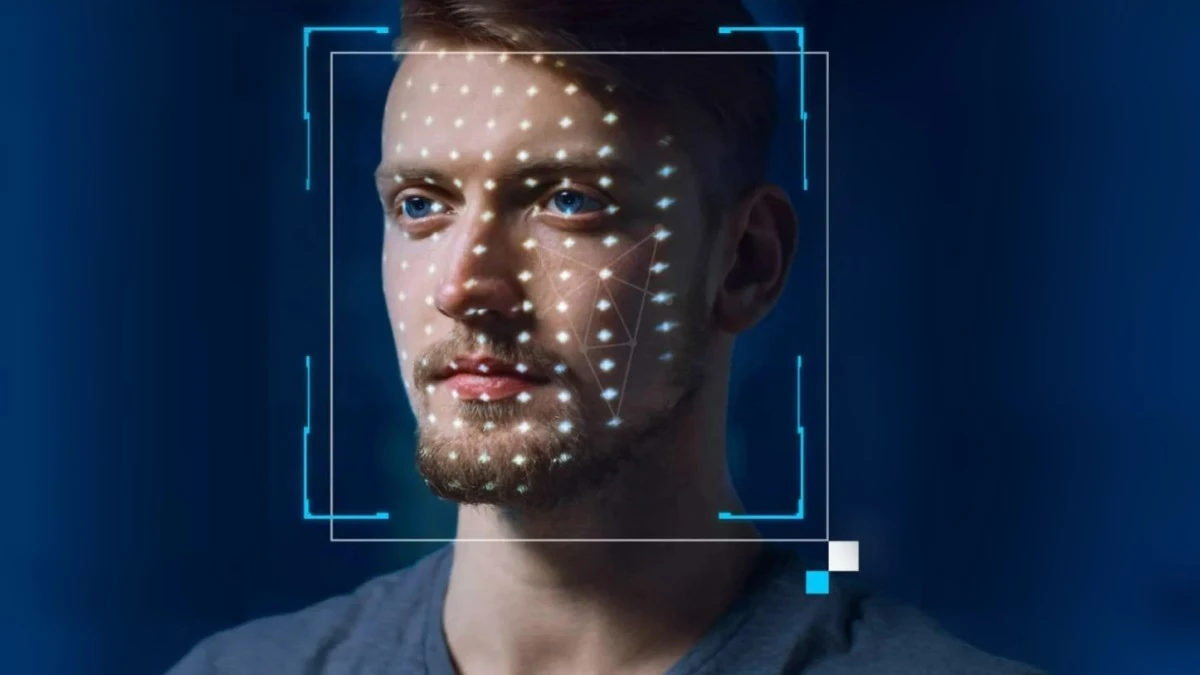

Tak się składa, że Intel opracował rozwiązanie zaprojektowane z myślą o wykrywaniu deepfake’ów. Jego nazwa to FakeCatcher. Podobno potrafi on rozpoznawać deefake’i z 96-procentową dokładnością.

„W ramach zapoczątkowanej przez Intel inicjatywy Responsible AI firma opracowała FakeCatcher, technologię, która może wykrywać fałszywe wideo z 96-procentową dokładnością. Platforma firmy Intel do wykrywania deepfake’ów to pierwsze rozwiązanie, które wykrywa deepfake’i w czasie rzeczywistym i przesyła rezultaty w ciągu milisekund.”, czytamy w oświadczeniu Intela.

Intel kontra deepfake’i

Tak, FakeCatcher wykrywa deepfake’i w czasie rzeczywistym. Jak to robi? Jak wyjaśnia Intel, inne narzędzia opracowane w tym samym celu próbują wykrywać deepfake’i, analizując surowe dane w plikach. Tymczasem, FakeCatcher został przeszkolony z użyciem technik nauczania maszynowego, aby analizował samo wideo w celu zdeterminowania, czy widać w nim prawdziwego człowieka. Oznacza to, że jest on w stanie wykryć cechy, które odróżniają prawdziwego człowieka od sfałszowanych zachowań. Dokładniej mówiąc, jest on w stanie wykryć, czy na twarzy widać oznaki przepływu krwi. Jest to coś, z czym deefake’i sobie na razie najwyraźniej nie radzą.

„Wykrywanie deepfake’ów w czasie rzeczywistym wykorzystuje sprzęt i oprogramowanie firmy Intel. Przebiega na serwerach i działa na platformie webowej.”, informuje Intel. „Większość detektorów bazujących na głębokim nauczaniu analizuje surowe dane, by spróbować wykryć ślady nieautentyczności i dowiedzieć się, co jest z filmem nie tak. FakeCatcher natomiast szuka śladów autentyczności na filmach, oceniając co sprawia, że wyglądamy ludzko – subtelny ‘przepływ krwi’ na pikselach w wideo. Gdy nasze serce pompuje krew, kolor naszych żył się zmienia. Te sygnały dotyczące przepływu krwi są zbierane z całej twarzy, a algorytmy je tłumaczą na mapy czasoprzestrzenne. Następnie, korzystając z nauczania maszynowego, możemy natychmiast wykryć, czy wideo jest prawdziwe, czy fałszywe.”

Technologia o niepokojącym potencjale

Cóż, wszystko to brzmi interesująco. Pytanie brzmi, czy sposoby na tworzenie deepfake’ów z czasem nie pozwolą na symulowanie przepływu krwi na fałszywych twarzach. Jeśli tak się stanie, albo inaczej – gdy tak się, Intel będzie musiał udoskonalić swoje rozwiązanie.

Takie narzędzia jak FakeCatcher są niesamowicie potrzebne. Deefake’i mogą bowiem stanowić zagrożenie dla bezpieczeństwa. Inwazja Rosji na Ukrainę pokazała, że można je wykorzystywać jako narzędzie do siania dezinformacji.

Źródło: Intel, fot. tyt. Intel