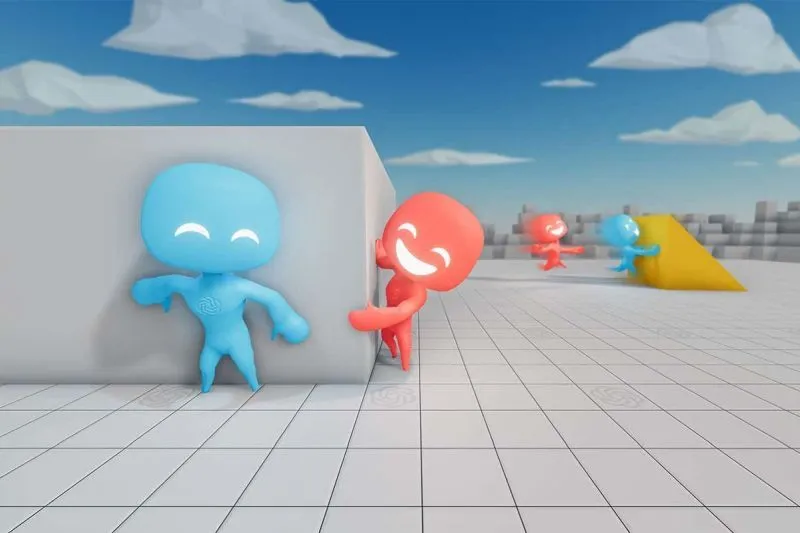

OpenAI, organizacja non profit założona między innymi przez Elona Muska, poświęcona badaniom nad sztuczną inteligencją i jej rozwojowi, przeprowadziła jakiś czas temu interesujący eksperyment, który bazował na… zabawie w chowanego. Z jego pomocą wykazano, w jaki sposób sztuczna inteligencja może wyewoluować pod presją konkurencji. Wyciągnięte wnioski są… niepokojące.

W ramach swojego eksperymentu organizacja OpenAI umieściła swoje boty, zwane także agentami AI, w środowisku, gdzie te rozegrały niemalże 500 milionów rund zabawy w chowanego. W ten sposób badacze chcieli sprawdzić, jak konkurencja, która w przyrodzie jest jednym z zasadniczych czynników doboru naturalnego (będącego mechanizmem ewolucji biologicznej), wpłynie na rozwój sztucznej inteligencji.

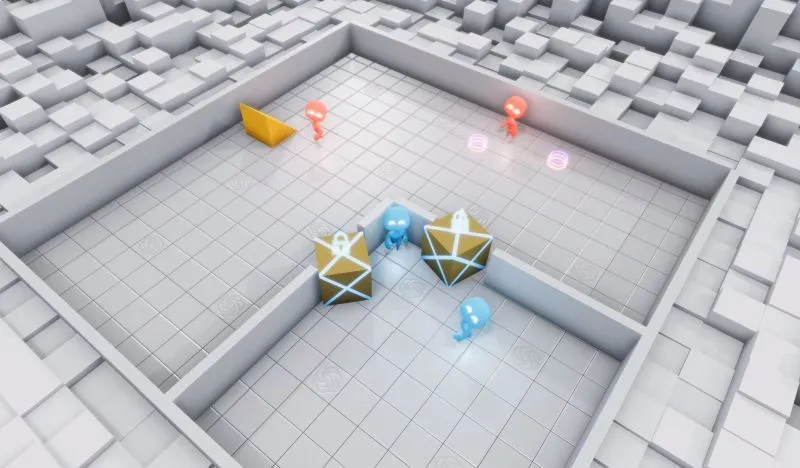

Na początku boty, podzielone na chowające się i szukające, po prostu we wspomnianym środowisku biegały. Jednak już po 25 milionach rund boty chowające się nauczyły się współpracować ze sobą i… oszukiwać, blokując wejścia do pomieszczeń, w których się znajdowały skrzyniami. Dopiero po 75 milionach rund szukający odnaleźli rozwiązanie tego problemu. Ci nauczyli się wówczas umieszczać pod ścianami rampy, które pozwalały im na dostanie się do zablokowanych pomieszczeń. Na ich nieszczęście po 85 milionach rund chowający się nauczyli się ukrywać rampy w blokowanych pomieszczeniach, odbierając szukającym ich narzędzie.

„Gdy jeden zespół opracowuje nową strategię, wywiera na drugi zespół presję, zmuszając go do adaptacji. Jest to naprawdę interesująca analogia do tego, jak ludzie wyewoluowali na Ziemi, gdzie nieustanna konkurencja między organizmami jest na porządku dziennym.”, powiedział Bowen Baker, jeden z badaczy z OpenAI.

Największą niespodzianką eksperymentu było to, że po pewnym czasie boty zaczęły wykorzystywać w zabawie… błędy związane z symulacją fizyki środowiska. Gdy szukający dowiedzieli się, że przysuwając rampę do ściany, mogą wystrzelić się w powietrze i dostrzec chowających się z góry, chowający znaleźli sposób na to, aby usunąć rampy ze środowiska, wypychając je pod odpowiednim kątem przez zewnętrzne ściany. Poza tym, boty nauczyły się wskakiwać na pudła i na nich „surfować”.

Naukowcy sugerują, że powyższe przykłady świadczą o tym, iż sztuczna inteligencja może być w stanie znaleźć rozwiązania dla kompleksowych, nierozwiązanych jeszcze przez nas problemów. Tymczasem, my mamy nadzieję, że sztuczna inteligencja nie wykorzysta swoich zdolności oszukiwania i adaptacji do przejęcia władzy nad światem. Skoro ta posiada takie zdolności, jasne jest, że nigdy nie powinniśmy ufać ani jej, ani potencjalnemu przekonaniu ich twórców, że sztuczna inteligencja jest niegroźna.

Źródło: OpenAI