Twitch nie chce trolli na swojej platformie

Internet pełen jest różnych ludzi – także tych, którzy lubią działać na niekorzyść innym i uprzykrzać im życie. Większość najpopularniejszych platform społecznościowych posiada już stosowne usprawnienia pozwalające w pewien sposób ograniczyć możliwość szerzenia nienawiści czy trollingu. Wyjątkiem od reguły nie jest Twitch – serwis ogłosił właśnie plany na ulepszenie swoich systemów bezpieczeństwa.

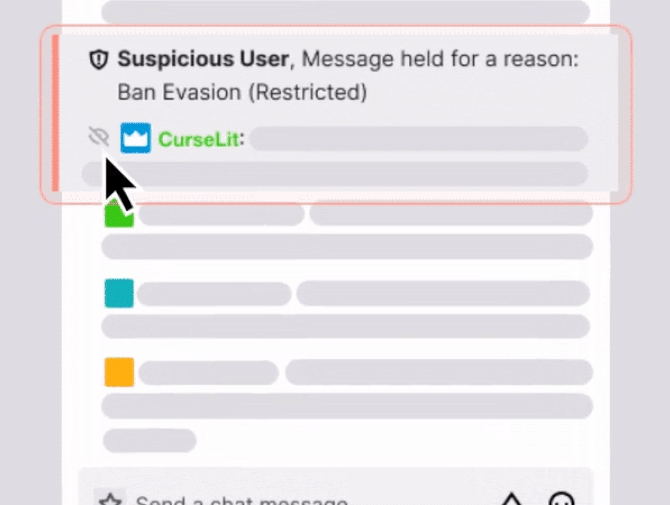

Mowa o narzędziu „Suspicious User Detection” wykorzystującym uczenie maszynowe w celu wykrywania i oznaczania osób wykazujących się podejrzanymi zachowaniami. Do takich zalicza się m.in. mowa nienawiści, jak i celowe unikanie blokady będące formą irytującego trollingu. System ma oznaczać takich użytkowników oraz wysyłać stosowne powiadomienie do streamera oraz jego moderatorów. Automatycznie zostanie im zabrana także możliwość wysyłania wiadomości na czat.

Osoby odpowiedzialne za transmisję będą mogły wtedy podjąć decyzję, co zrobić z oznaczonym osobnikiem – zablokować go lub umożliwić mu dalsze komentowanie streama. Rzecznik platformy Twitch wypowiedział się o nowości w następujący sposób:

Narzędzie jest zasilane przez model uczenia maszynowego, który bierze pod uwagę szereg sygnałów – w tym, ale nie tylko, zachowanie użytkownika i cechy konta – i porównuje te dane z kontami wcześniej zbanowanymi na kanale twórcy, aby ocenić prawdopodobieństwo, że konto unika poprzedniego bana na poziomie kanału.

Osoby próbujące organizować tak zwane „hate speech raids” będą miały więc dosyć utrudnione zadanie, bo SI w części przypadków będzie wykrywała aktywność wykonywaną z poziomu jednego konta. Oczywiście skuteczność funkcji nigdy nie będzie wynosić 100 procent, na co wskazuje sam Twitch – dlatego też dalej bardzo istotna jest rola moderatorów.

Nowość powinna być dostępna dla wszystkich osób decydujących się na przeprowadzenie transmisji na żywo, lecz dokładny termin jej wdrożenia nie został jeszcze podany.

Źródło: Engadget / Foto. Twitch